Le Centre de Transport a initié un programme de recherche collaboratif dans le but d’améliorer la sécurité et le confort du conducteur. Ce programme se concentre sur des interfaces homme-machine non-invasives basées sur l’image.

L’objectif principal de ce programme de recherche est d’extraire du visage du conducteur autant d’informations pertinentes que possible tout en utilisant uniquement des moyens non invasifs. Plusieurs techniques d’analyse de visage existent déjà (reconnaissance des expressions faciales, suivi des yeux, lecture sur les lèvres…) mais elles ne peuvent pas être appliquées telles quelles au contexte automobile. En effet, l’espace restreint, les variations des conditions lumineuses, la personnalité du conducteur et les exigences de sécurité ne sont que quelques-uns des défis qui imposent de tester, de valider et d’adapter les techniques existantes ou à venir au domaine automobile.

Depuis 2012, cette collaboration scientifique a conduit à plusieurs projets de recherche:

- Mesures physiologiques basées sur l’imagerie par caméra (2015)

Ce projet vise à démontrer les performances de la mesure des rythmes cardiaque et respiratoire par caméra sous éclairage infra-rouge, en environnement automobile.

Les constructeurs de voitures cherchent à connaître l’état du conducteur du véhicule tant pour des questions de sécurité que de confort. Ce projet vise à déterminer son état physiologique, en mesurant ses rythmes cardiaque et respiratoire, de manière non invasive. Pour cela, il exploite les images vidéo du visage éclairé sous infrarouge.

Contrairement aux techniques classiques de mesure de l’état physiologique, celle-ci possède l’avantage de fonctionner sans contact. Elle n’est donc pas soumise aux artefacts dus aux mauvais contacts, comme peuvent l’être les techniques avec capteurs physiologiques. Elle semble ainsi très bien adaptée à cette application dans l’habitacle automobile.

Ce projet cherche à valider cette technique et à quantifier la robustesse aux variations de conditions telles que nous pouvons les rencontrer dans un habitacle de voiture (variations de la luminosité ambiante, mouvements du conducteur face à la caméra).

D’une durée de trois mois, il est dirigé par le Laboratoire de traitement des signaux (LTS5) du professeur Jean-Philippe Thiran en collaboration avec le Groupe de traitement des signaux appliqué (ASPG) du Dr Jean-Marc Vesin. Il est financé par Groupe PSA.

- Surveillance de l’état psychologique du conducteur (2014-2015)

Ce projet vise à définir et à détecter les états émotionnels pertinents du conducteur afin d’estimer son état physiologique.

Ces dix dernières années, le Laboratoire de traitement des signaux (LTS5) a développé une expertise dans l’analyse de visage. Ce projet vise à estimer l’état émotionnel du conducteur grâce à l’analyse de ses expressions faciales. La première étape consister à fournir une définition des émotions et des états pertinents pour l’interface pilote-voiture. La deuxième étape comprend le développement d’un système de détection des émotions en temps réel. La dernière partie s’attache à la détection spécifique de l’attention et de la distraction du conducteur sur la base des informations fournies par le visage.

D’une durée de 24 mois, il est réalisé par le LTS5 et financé par Groupe PSA et Valeo.

- Reconnaissance audiovisuelle de la parole (2013-2014)

Ce projet vise à démontrer que l’information visuelle peut améliorer de façon significative la reconnaissance vocale dans un contexte automobile réaliste.

Dans le domaine des interfaces homme-machine, le visage tient une place centrale. Il est reconnu comme un des principaux convoyeurs naturels d’informations, au même titre que les gestes ou la voix. Le but de ce projet est de démontrer que les images du visage d’un conducteur peuvent améliorer de façon significative les systèmes de reconnaissance automatique de la parole, dans l’habitacle d’une voiture.

Des travaux précédents, réalisés au LTS5, ont permis de montrer que l’information visuelle augmente les performances de reconnaissance automatique de la parole lorsque le canal audio est parasité, ce qui est fréquent dans une voiture (bruits de moteur, bruits aérodynamiques, bruits extérieurs ou intérieurs, etc.). Ce projet transpose ces acquis dans l’habitacle d’une voiture. A l’aide d’un véhicule mis à disposition par le constructeur français, les chercheurs vont créer une base de données audiovisuelle pour tester et quantifier les performances de la reconnaissance audio et audiovisuelle de la parole. Ces données seront intégrées dans les outils de détection et de suivi des visages disponibles dans le cadre du partenariat entre LTS5 et Groupe PSA.

Ce projet d’une durée de dix mois est mené par le LTS5 et financé par Groupe PSA.

- Détecteur d’émotions (2012-2013)

Ce projet vise à développer un système de surveillance non-intrusif qui détecte l’état émotionnel du conducteur.

Surveiller l’état émotionnel du conducteur est essentiel pour la sécurité et le confort de conduite. Dans ce projet, un système de surveillance non-intrusif en temps réel est développé. Il détecte les états émotionnels du conducteur en analysant ses expressions faciales. Le système tient compte de deux émotions de base, la colère et le dégoût, des émotions associées au stress.

Au cours du projet de recherche, les scientifiques ont réalisé des vidéos. Ils détectent les émotions individuelles sur chaque image et l’évaluation du niveau de stress se fait au niveau de la séquence. Les résultats expérimentaux montrent que le système mis au point fonctionne très bien sur des données simulées, même avec des modèles génériques. Une étape d’adaptation supplémentaire permettra d’améliorer encore le système actuel.

D’une durée d’un an, il est dirigé par le LTS5. Il est financé par Groupe PSA.

- Détecteur de fatigue (2013)

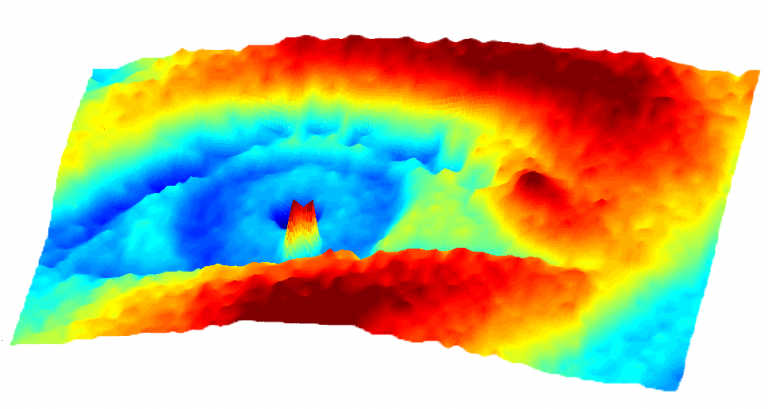

Ce projet vise à développer un algorithme de vision par ordinateur capable d’estimer le niveau de fatigue d’un conducteur sur la base du degré de fermeture des paupières.

Dans le domaine des véhicules intelligents et de l’assistance à la conduite, la détection de fatigue joue un rôle important. Les estimations indiquent que jusqu’à 30% des accidents de voiture sur les autoroutes pourraient être liés à la somnolence du conducteur. Par conséquent, un système capable de détecter cet état et d’avertir le conducteur pourrait contribuer à réduire de manière significative les accidents.

Une façon intuitive de mesurer la fatigue est l’utilisation d’une caméra et la détection des symptômes liés à la fatigue. L’indicateur PERCLOS, qui mesure le pourcentage de temps durant lequel l’œil est fermé à l’intérieur d’un certain laps de temps, offre une corrélation significative de la somnolence et est relativement facile à calculer.

Ce projet se concentre sur la détection de la fermeture de l’oeil dans le but d’utiliser ensuite le PERCLOS comme indicateur du niveau de fatigue. Son but est de développer un module d’analyse de l’oeil en créant un algorithme capable de ne pas tenir compte des éventuels effets de la lumière et des différentes morphologies des yeux des conducteurs. Un profilage 3D de l’oeil et des paupières est alors établi de façon à distinguer un oeil ouvert d’un oeil fermé. Enfin, la méthodologie est optimisée pour permettre à l’algorithme de fonctionner en temps réel sur des ordinateurs embarqués dont la puissance de calcul est limitée.

Ce projet de master est réalisé au LTS5 et financé par Groupe PSA.

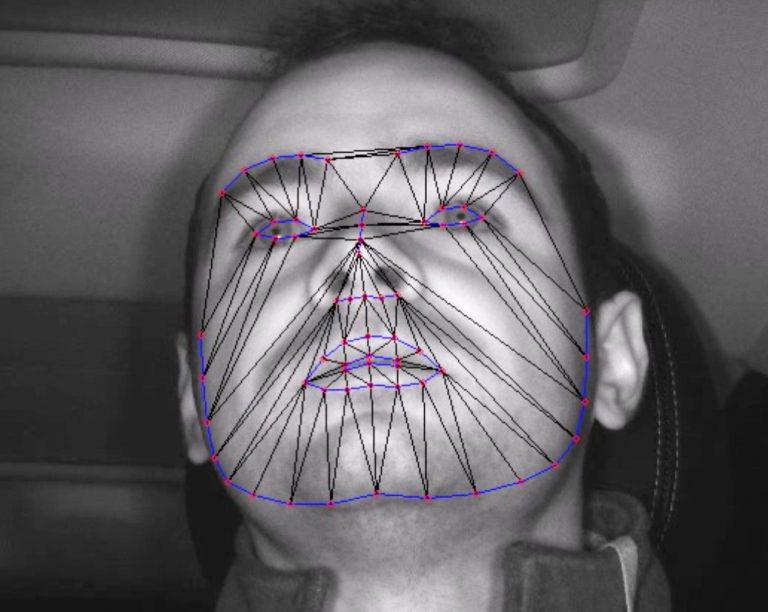

- Plateforme de prototypage pour le suivi des visages (2012-2013)

Ce projet développe, teste et valide de nouvelles techniques de détection robuste du visage, d’analyse du visage et de suivi du regard sur une plateforme de prototypage pour interfaces homme-machine dans l’automobile.

Il vise à mettre en place une plateforme de développement, spécifiquement dédiée à l’analyse en temps réel du visage et du regard par caméra vidéo, sur la plate-forme de prototypage P2S (plateforme de prototypage et simulation), fournie par Groupe PSA.

Ce projet étudie plusieurs aspects essentiels. Tout d’abord, les algorithmes pour le suivi du visage sont transférés sur la plate-forme P2S et leurs performances évaluées en termes de puissance de calcul et de robustesse pour les applications automobiles. Puis, en fonction de ces performances, les chercheurs intègrent des matériaux plus spécifiques, comme les cartes de GPU, afin d’atteindre les performances requises pour le traitement en temps réel. Dans une troisième phase, ils adaptent la détection de visage et le suivi aux conditions de nuit avec un éclairage infrarouge et proposent des méthodes qui sont robustes aux conditions variables d’éclairage et d’occlusions.

Dans une quatrième phase, ils étudient la possibilité d’améliorer l’exactitude des méthodes proposées par l’utilisation de deux caméras HD au lieu d’une, tout en maintenant l’exécution en temps réel sur la plate-forme P2S. Enfin, ils identifient les applications automobiles de ces algorithmes avec Groupe PSA et les présenteront sur un démonstrateur.

D’une durée d’un an, ce projet est mené par le LTS5 et financé par Groupe PSA.